1. 개요

데이터마이닝 시 데이터 분석가에게 많은 노력이 요구되지 않으면서 분석가가 쉽게 분석결과를 이해할 수 있는 범용적 기법으로 나무방법론(Tree methodology)이 있다. 이러한 분류나무모델이 흔히 사용되는 이유는 나무가 매우 큰 경우에도 나무 규칙을 이해하기 매우 쉽기 때문이다.

2. 분류나무

분류나무에서 기본이 되는 2가지 핵심 내용은 독립변수의 차원 공간을 반복적으로 분할하는 것과 평가용 데이터를 사용하여 가지치기를 하는 것이다.

3. 반복적 분할

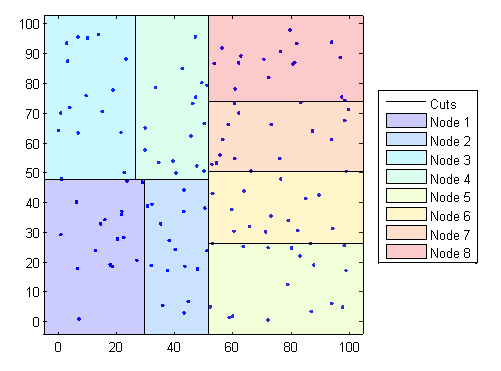

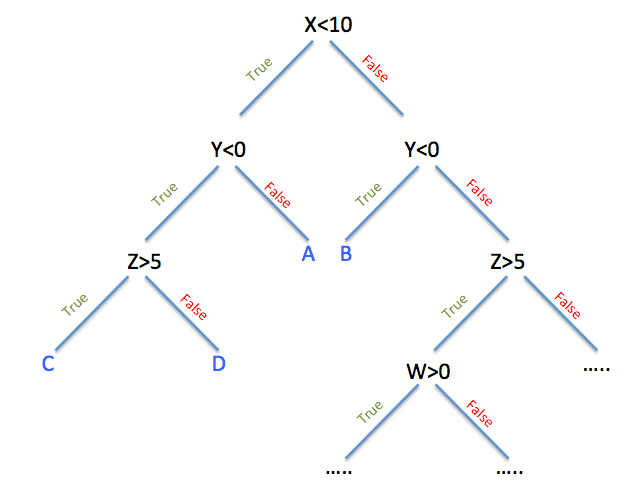

종속변수는 y로, 독립 변수는 x1, x2, ..., xp로 표시된다고 할 때, 분류문제에서 반응변수는 범주형 변수이어야 한다. 반복적 분할은 변수 x의 p 차원 공간을 겹치지 않는 다차원 직사각형으로 나눈다. 여기서 변수 x는 연속형, 이진 혹은 서열 척도이다. 먼저 변수 중 하나인 x1이 선택되고 x1의 값이 p차원 공간을 2개의 부분으로 나눈다. 그런 후 다시 변수를 선정해서 같은 방식으로 나눈다. 이 결과 3개의 직사각형 영역이 된다. 이러한 과정이 계속되면 직사각형 영역이 더욱 작아진다. 이 개념은 모든 x-공간을 직사각형으로 나누어 각 직사각형이 가능한 한 순수하게 또는 동질적이 되도록 하는 것이다.

1) 불순도 측정치

불순도를 측정하는 방법은 여러가지가 있다. 가장 대표적인 2가지로는 지니지수(Gini Index)와 엔트로피 지수(Entropy measure)가 있다.

4. 분류나무의 성과평가

새로운 사례를 분류할 때 나무의 정확도를 평가하기 위해서는 도구와 기준을 사용할 수 있다. 우선 데이터를 학습용과 평가용 데이터 집합으로 나눈다.

학습용 집합은 나무를 학습하는데 사용하되고 평가용 집합은 나무의 성과를 측정하는 데 사용된다.

평가용 데이터의 각 관찰치는 나무에 적용하여 나무에서 연결된 끝마디에 따라 분류된다. 이렇게 예측된 집단은 정오분류표(Confusion Matrix)를 통해 실제 소속값과 비교된다. 특정 집단에 관심이 있을 경우, 리프트 도표는 모델이 각 소속값을 잘 분류할 수 있는지를 평가하는데 유용하게 사용된다.

5. 과적합 없애기

학습용 데이터를 이용하여 구축된 완전히 성장한 나무는 데이터를 과적합 시키게 된다. 과적합은 새로운 데이터에 대해서 낮은 성과를 초래하게 만든다. 나무의 다양한 분할 수준에서 전체 오차를 살펴보면 과적합을 하게 되면 분할 수준의 수가 증가하면서 전체적인 오차가 감소한다. 물론 학습용 데이터에 대해서는 전체 오차가 거의 0이 된다. 그러나 새로운 데이터 대해서는 나무가 집단과 예측변수 사이의 관계를 모형화하는 학습이 종료되는 시점까지는 오차가 감소하지만, 이 지점을 지나게 되면 나무는 점차 학습용 집합에서 잡음을 모델화 하고, 평가용 집합에 대한 전체 오차는 증가하게 된다.

과적합을 제한 하는 2가지 방법은 나무의 성장을 멈추는 것과 완전히 성장한 나무의 가지치기를 해 주는 것이다.

1) 분류나무 학습의 중단

나무가 데이터를 과적합시키기 이전에 나무의 성장을 중단시키기 위한 다양한 기준이 제시될 수 있다. 예를 들어 나무의 깊이(마디 분할의 개수), 마디 안에서의 최소 데이터 개수, 불순도의 최소한의 감소 등이 있다. 그러나 이러한 규칙을 사용하여 적절한 학습종료시점을 결정하는 것이 간단하지는 않다.

2) 분류나무의 가지치기

과적합에 대한 또다른 해결방법으로는 나무 성장을 멈추게 하는 것보다 더 성공적인 방법으로 완전히 성장한 나무에 대한 가치 치기를 적용하는 것이다.

가지치기에 대한 기본적인 아이디어는 매우 큰 나무는 학습용 데이터에 대해 과적합화될 여지가 많으며, 오차를 거의 줄일 수 없는 가장 성능이 낮은 가치는 제거되어야 한다는 것이다.

6. 회귀나무

예측을 위한 회귀나무 역시 분류나무와 동일한 방식을 작동한다. 회귀나무에서는 출력변수가 연속형 변수이고, 원리와 절차 모두 분류 나무와 동일히다. 많은 분할이 이루어지고, 각 분류별로 나무의 각가지에서의 불순도를 측정한다. 그러고 나서 나무절차는 불순도의 합이 최소가 되는 분할을 선택한다.

1) 예측

관찰치를 대상으로 반응변수의 값을 예측하는 것은 분류나무에서와 비슷하게 수행된다. 예측변수에 대한 정보는 끝마디에 도달할 때까지 나무를 학습시키는 데 사용된다.

2) 불순도 측정

분류나무의 마디에 대한 2가지 불순도 측정치는 지니지수와 엔트로피 지수가 있다. 이 지수는 모두 해당 마디의 관찰치들의 범주 사이의 비율함수로 정의된다. 끝마디의 평균과의 제곱편차의 합을 회귀나무에서의 전형적인 불순도 측정치이다.

3) 성과 평가

예측은 마디의 출력변수값의 평균을 통해서 얻어진다. 평균제곱오차의 제곱근 (RMSE)와 같은 요약측정치와 리프트도표와 같은 그래프를 이용하여 평가할 수 있다.

'숫자' 카테고리의 다른 글

| 신경망 모델 (0) | 2023.04.12 |

|---|---|

| 로지스틱 회귀분석 (0) | 2023.04.11 |

| 3가지 유형의 단순분류기법 (0) | 2023.04.09 |

| 다중 선형 회귀분석 (0) | 2023.04.08 |

| 분류 및 예측모델의 성과평가 (0) | 2023.04.07 |

댓글